FAKE NEWS, VERSCHWÖRUNGSTHEORIEN, HASS IM NETZ…: EIN LÖSUNGSVORSCHLAG

[An automatic translation by DeepL, the best translation AI on this planet, can be found here.]

Es ist inzwischen ein trauriger Normalzustand geworden: tagtäglich neue Medienmeldungen über Hass im Netz, Fake news, Desinformation, Propaganda, Verschwörungstheorien etc. etc. Und welche Lösungen werden für dieses Problem vorgeschlagen? Klarmamenpflicht, Faktenchecks, Gegendarstellungen, Kontrollen, Contentfilter… Kaum jemand will so weit gehen wie z.B. Sacha Baron Cohen, der eine obligatorische Prüfung aller Postings vor deren Veröffentlichung vorschlug – und Zuckerberg für die Inhalte, die sein Unternehmen verbreitet ggf. persönlich haftbar zu machen:

„Maybe it’s time to tell Mark Zuckerberg and the CEOs of these companies: you already allowed one foreign power to interfere in our elections, you already facilitated one genocide in Myanmar, do it again and you go to jail.“

Der Haken an allen noch so gut gemeinten Vorschlägen, Inhalte erst nach Prüfung zu veröffentlichen: bei vier Millionen geteilter Facebook-Posts pro Minute und 500 Millionen Tweets pro Tag (Stand Frühjahr 2020) ist das ein Unding. Auch wenn nur ein geringer Anteil überprüft werden müsste, bleibt das Problem: wie soll man diese Nadeln im Heuhaufen finden? Entweder in „Handarbeit“ oder automatisch. Keine der beiden Optionen kann überzeugen. Menschliche Prüfer sind von der Masse der Inhalte vollkommen überfordert, und noch während sie suchen und aussortieren, wird neuer Müll gepostet. Dieses „Einzelfallprinzip“ – die einzelnen Posts werden von einzelnen Menschen überprüft – ist undurchführbar. Zudem, es gibt in vielen Fällen keine scharfe Grenze zwischen „wahr“ und „falsch“. Was tun mit Halbwahrheiten? Verzerrungen? Übertreibungen? Entstellungen? Überhaupt, wer entscheidet, was veröffentlicht werden darf und was nicht? Welche Inhalte sind von dem Recht auf „freie Meinungsäußerung“ gedeckt und was nicht mehr? In welchen Fällen wird dieses Recht unberechtigterweise in Anspruch genommen und nur aus taktischen Gründen vorgeschützt? Wo fängt Zensur an und wo hört sie auf? Ich will die ganzen berechtigten Einwände nicht ein weiteres Mal ausbreiten. Was Menschen schon nicht eindeutig hinbekommen können, wird eine künstliche „Intelligenz“ noch weniger schaffen. Kein Algorithmus, und sei er noch so „smart“ wird jemals die notwendige Treffsicherheit erlangen, um zwischen richtig und falsch unterscheiden zu können. Das Problem liegt darin, dass versucht wird, dem Problem weiterhin auf der inhaltlichen Ebene beizukommen, wenn auch mit den Mitteln der KI. Sowohl die menschliche als auch die maschinelle Prüfung der Inhalte ist zum Scheitern verurteilt.

Wenn ein System das Problem ist, kann auch die Lösung nur in einer Systemveränderung liegen.

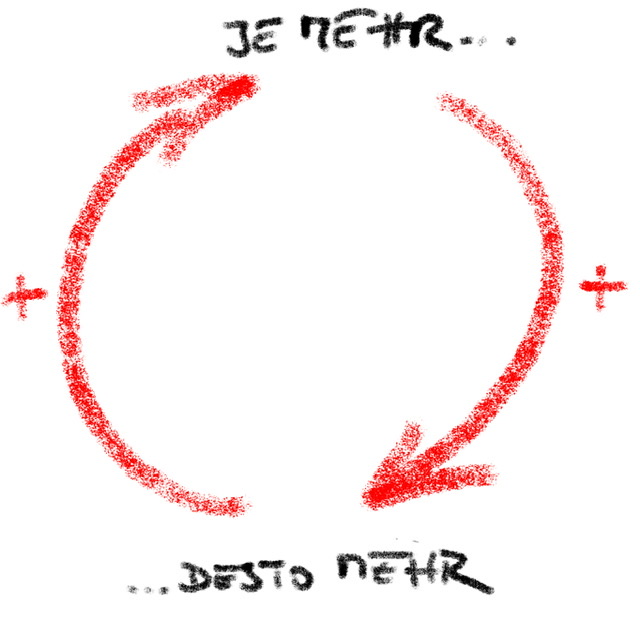

Das „Erfolgsprinzip“ der Netzwerkmedien ist bekannt: Je mehr Klicks, desto mehr Geld. Je mehr Klicks, desto größere Reichweite, desto höhere Werbeeinnahmen, desto mehr Gewinne, desto mehr Unternehmenswachstum, desto mehr Verbreitung… Die Grundproblematik ist also ein sogenanntes System: Je mehr, desto mehr.

Diese Systemdynamik begegnet uns heutzutage, wohin man auch schaut: Je mehr Quote, desto mehr Auflage, desto mehr Quote. Je mehr Wählerstimmen, desto mehr politische Macht, desto mehr Wähler. Je mehr Kapital, desto mehr Anlagevermögen, desto mehr Kapital (“(„wer hat, dem wird“). Je mehr positive Gästefeedbacks auf Booking.com, Airbnb usw., desto mehr Buchungen, desto mehr Marktdominanz dieser Plattformen, desto mehr Buchungen, desto mehr Gästefeedbacks; und so weiter und so fort. Dieses Prinzip, das jeder von akustischen Rückkopplungen (Feed-backs) kennt ist ein "selbstverstärkender Kreislauf". Das Fatale an solchen Kreisläufen ist, dass sie lawinenartig anwachsen bis sie entweder auf einen begrenzenden Faktor treffen, der sie einbremst, oder das System zerstören.

So auch bei den Netzwerkmedien und ihren o.g. Inhalten. Auch ihr „Erfolgsprinzip“ ist „Je mehr, desto mehr“.

Und auch sie treiben die selbstverstärkende Rückkopplung auf die Spitze bis die so polarisierte Gesellschaft sich in einem bürgerkriegsartigen Kampf der verfeindeten Lager selbst zerfleischt. Weil das Problem ein systemisches ist, braucht es auch eine systemische Lösung dafür – einen begrenzenden Faktor, der die Selbstverstärkung rechtzeitig einbremst.

DIE LÖSUNG: EIN AUTOMATISCHER DROSSELUNGS-ALGORITHMUS

Ein solcher Algorithmus beruht auf dem Prinzip eines mechanischen Drehzahlreglers:

Je mehr Energie zugeführt wird, desto schneller drehen sich die Kugeln. Je schneller sie sich drehen, desto weiter zieht die Fliehkraft sie nach außen. Je weiter die Kugeln nach außen wandern, desto höher ziehen sie das Gewicht an ihrer Achse nach oben. Je weiter es nach oben wandert, desto mehr – und hier kommt der "begrenzende Faktor" ins Spiel – wird über Hebelstangen die Energiezufuhr reduziert. Die Gewichte senken sich, und ein Gleichgewicht zwischen Energiezufuhr und Drehzahl stellt sich ein. So kann z.B. bei einer Mühle oder einem Motor eine konstante Drehzahl erreicht werden, was James Watt bei den von ihm erfundenen Dampfmaschinen erstmals anwendete.

Es hat vielerlei

Anwendungen bei diversen Arten von Notfallbremsen und automatischen Geschwindigkeitsdrosseln, wie z.B.

- Sicherung von Aufzügen, wenn das Seil reißt

- Notbremsen für Windkraftanlagen, die bei Stürmen automatisch zum Stillstand gebracht werden

- Abseil- und Sicherungsgeräte beim Sportklettern, die einen unkontrollierten Zug, d.h. einen ungebremsten Fall verhindern

- Zentrifugalbremsen von Angelrollen, dank derer man das Abspulen der Leine nicht manuell verlangsamen muss

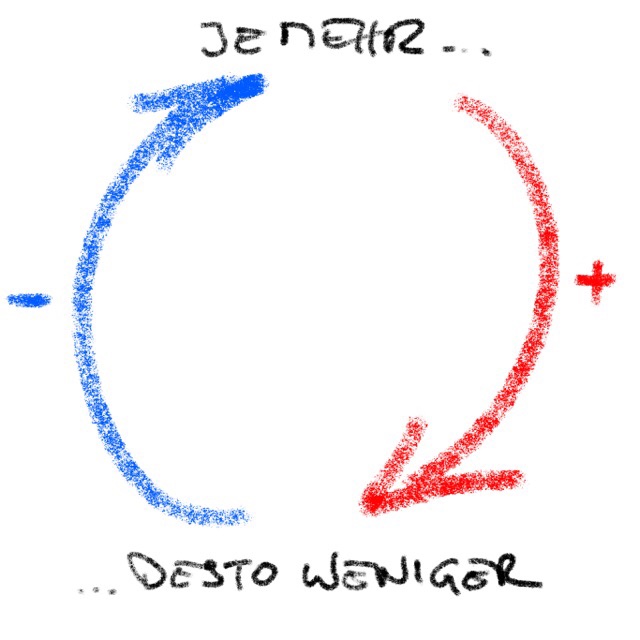

Allgemein formuliert, lautet dieses Prinzip: Je größer die Energiezufuhr, desto größer der Spin, der sich aber ständig durch die automatische Drosselung selbst einbremst, sodass sich ein Gleichgewichtszustand (eine konstante Geschwindigkeit) einstellt. Auch wenn die Energiezufuhr nicht vermindert werden kann, dann kann man ihre Wirkung dennoch mit einer solchen Drossel nach Belieben regeln. Man braucht im Prinzip nur den selbstverstärkenden Algorithmus auf den Kopf zu stellen: statt plus – minus. Statt „je mehr, desto mehr“ – je mehr, desto weniger.

Auf die Netzwerkmedien angewendet, könnte ein derartiger Brems-Algorithmus so funktionieren: Je mehr Menschen einen Beitrag sehen / „liken“ / teilen, desto größer wird dessen „Spin“. Die Menge der Beiträge (die „Energiezufuhr“) kann kaum gebremst werden; sehr wohl aber ihre Eigendynamik: Je größer ihr Spin, desto mehr könnte er durch einen solchen Drosselungs-Algorithmus gebremst werden, ggf. bis auf Null. Eine solche automatische Drosselung würde von vornherein jede lawinenartige Eskalation verunmöglichten.

Dasselbe gilt für die berüchtigten „Blasen“, in denen Gleichgesinnte sich in ihren Überzeugungen gegenseitig bestärken und aufschaukeln, während sie sich gleichzeitig von allem abschotten, was ihre Dogmen in Frage stellen würde. Statt riesiger „Blasen“ hunderttausender Menschen wären nur winzige „Bläschen“ möglich, die das Gesellschaftsleben nicht mehr beeinflussen und gefährden können.

Ein solcher Algorithmus würde keine der oben umrissenen Schwächen manueller Aussortierung haben. Er wäre schnell und effizient; er bräuchte keinerlei Urteile zu fällen, und weil er nicht zwischen „wahr“ und „falsch“ unterscheiden müsste, wäre er a priori „unfehlbar“. Er wäre Inhalts-neutral. Nicht diese oder jene Inhalte wären ausschlaggebend dafür, ob sie stehen bleiben dürfen oder nicht (was zwangsläufig den Beigeschmack von Zensur hat oder Zensur ist), sondern allein die systemische Eigendynamik, die sie auslösen. Damit könnte sich kein Beitrag mehr „viral“ verbreiten – egal welchen Inhalt er hat, egal von wenn und mit welchen Absichten er in die Welt gesetzt wurde. Das würde auch dem Vorwurf der Zensur und der einseitigen Einflussnahme auf die öffentliche Meinung zuvorkommen.

Damit erübrigen sich nicht nur alle böswilligen Beeinflussungsversuche politischer Splittergruppen und in- oder ausländischer Trolle. Ihr "Hebel" zur breiten Manipulation der Gesellschaft greift nicht mehr. Damit erübrigt sich auch die Verbreitung von Fake news, Verschwörungstheorien etc. über die Netzwerkmedien und Nachrichten-Apps. Sobald Beiträge einen Spin bekommen, wird er automatisch gedrosselt und ggf. abgedreht.

Ein Drosseluns-Algorithmus hätte über seine unmittelbare positive Wirkung auf die Netzwerkmedien und ihre Nutzer hinaus auch mittelbar einschneidende Folgen für deren Betreiber. Da das gesamte Erfolgsmodell von Facebook und Twitter auf dem Prinzip des Je mehr, desto mehr aufgebaut ist, wird ein Algorithmus, der genau dieser Rückkopplung entgegenwirkt deren Geschäftsmodell zum Einsturz bringen. Es wäre kein symptomatische Maßnahe wie die Aufspaltung von Facebook oder Alphabet. Deren eigentliches Problem sind ja nicht ihre CEOs, sondern das System, in dem diese Konzerne funktionieren, funktionieren müssen, wenn sie weiter existieren wollen. Dieses System wird ein Drosselungs-Algorithmus einschneidend beeinflussen – und wohl zum Stillstand bringen. Denn wenn die Rückkopplung Je mehr Klicks, desto mehr Geld nicht mehr funktioniert, war es das mit ihrem Erfolgsmodell.

Der Netzwerk-Effekt – ein Medium ist umso attraktiver, je mehr Menschen es nutzen, was die Attraktivität des Mediums weiter erhöht – hat mit systemischer Notwendigkeit zur Quasi-Monopolbildung von Facebook und Twitter geführt, aber auch von Amazon, Booking.com, Google… Man kommt an ihnen nicht mehr vorbei. Der von mir vorgeschlagene Drossel-Algorithmus würde "nebenbei" auch den Netzwerkeffekt einbremsen und damit effektiv der Monopolbildung entgegenwirken, die bislang erst bekämpft wird, wenn das Kind schon ins Wasser gefallen ist, d.h. wenn sich die Monopole schon entwickelt haben.

Facebooks "Mission Statement"

"give people the power to build community and bring the world closer together"

stünde zu so einer automatischen Bremse nicht im Widerspruch; ganz im Gegenteil. Während die Netzwerkmedien derzeit vor allem das Gemeinwesen zerstören und die Welt in feindlichen Lager polarisieren, könnte ihnen ein Brems-Algorithmus sogar dabei helfen, die spaltenden Kampagnen im Keim zu ersticken. Dann wäre Facebook wieder das Familien-und-Freunde-Medium, als das es irgendwann einmal gedacht war – vor dem Börsengang. Aber derzeit ist die Frage, ob Zuckerberg, Bezos und Co. sich jemals mit einem solchen Drosselungs-Algorithmus ins Knie schießen würden eine bloß rhetorische. Die derzeitigen exklusiven Märkte, insbesondere die Finanzmärkte können sich nicht selbst systemisch regulieren, denn jenes Je mehr, desto mehr ist genau ihre System-DNA. Darum ist ein politisches Machtwort notwendig, das Facebook und Twitter vorschreibt: Bis zu einem Spin X braucht ihr nicht zu drosseln, von X bis Y mit zunehmender Bremswirkung, und ab Y zu 100%. Aber wenn ein solches Machtwort sich abzeichnet, werden wohl die Investoren flugs ihre Schäfchen ins Trockene bringen und ihre Milliarden abziehen, sodass die Intervention sich ohnehin erübrigt.

Wird die Politik wohl dieses Rückgrat aufbringen? So sehr, wie sie nach wie vor mit Konzernen und ihren Lobbyisten verfilzt ist, scheint mir das undenkbar. Da bräuchte es wohl vorher auch ein anderes politisches System – aber das ist ein anderes Thema.